Se prestan a experimentos en los que hacen y dicen lo que les dicta otra persona o una computadora. ¿Cuál es su propósito?

Sophia Ben-Achour parece una típica estudiante londinense. Tiene el pelo corto castaño, ojos bailones y una gran sonrisa.

Nunca pensarías que su mente está siendo controlada por una serie de procesadores situados a más de 320 kilómetros.

Estar poseído por una computadora no es tan desconcertante, me explica ella. "Hoy es la primera vez que he pensado, eh, soy solo un cuerpo y nada más".

En términos técnicos, Sophia es un "ecoborg", una persona que respira y vive y funciona como la portavoz de un robot.

Todo lo que dice se originó en un robot hablante Internet. Las palabras le llegan a ella a través de una pequeña pieza en el oído.

Parece una historia de ciencia ficción distópica, pero en realidad este experimento tiene un objetivo serio.

Apariencia e inteligencia

Investigadores de la London School of Economics quieren entender cómo el cuerpo y la apariencia de la inteligencia artificial pueden condicionar nuestra percepción.

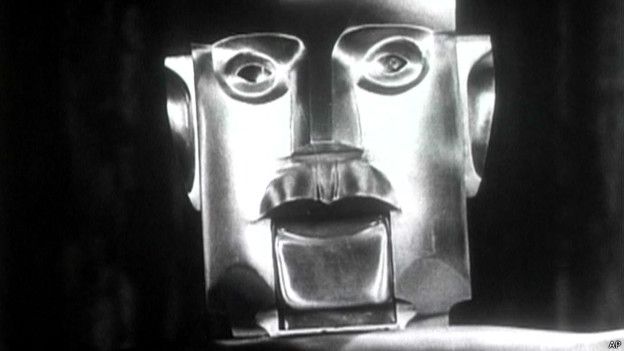

Esto es crucial para nuestro entendimiento de la Inteligencia Artificial, porque en el futuro puede ser que estemos rodeados de máquinas que sean indistinguibles de nosotros mismos, y necesitamos saber cómo reaccionar.

"La mayor parte de las veces que nos enfrentamos con la Inteligencia Artificial hoy en día es en una interface muy mecánica", dice Kevin Corti, uno de los investigadores.

Su respuesta fue utilizar un cuerpo humano con una mente de robot. "Se hace de forma que la gente crea que está en realidad hablando con otra persona".

Cori y su supervisor, Alex Gillespie, se inspiraron en el trabajo sobre "cyranoides", un experimento inventado por el controvertido psicólogo Stanley Milgram.

Milgram es famoso por un experimento sobre la obediencia, en el que pidió a los sujetos que infringieran descargas eléctricas de cada vez más intensidad a otras personas.

Al final de su vida, sin embargo, Milgram se dedicó al tema más ligero de la percepción corporal.

¿Cuando hablamos con alguien, escuchamos de verdad lo que nos dicen? ¿O nuestras opiniones se forman previamente, en base solo a la apariencia de esa persona?

Para averiguarlo, simuló la obra Cyrano de Bergerac, del siglo XIX.

Cyranoides

De Bergerac es un buen soldado, un poeta ingenioso y un músico capacitado, pero se considera a sí mismo demasiado feo para conquistar a su hermosa prima Roxane.

Por eso, se ofrece a ayudar a su bello pero tonto rival Christian para que la conquiste, diciéndole exactamente qué es lo que debe decir a Roxane para conseguirlo.

Un truco similar, se dio cuenta Milgram, sería perfecto para comprobar cómo nuestros cuerpos dan forma a las percepciones de nuestra mente.

Así que realizó experimentos en los que un "cyranoide" recibe palabras de otra persona situada en otra habitación a través de un pequeño radiotransmisor en el oído.

Como Roxane en la obra, los participantes no saben nada del experimento.

Milgram se sorprendió al descubrir que la mayor parte de la gente tenía conversaciones largas de 20 minutos con el cyranoide sin darse cuenta de que algo no iba bien.

"Que todo lo que la otra persona decía se originaba en un lugar lejano… simplemente no entraba en su cabeza", escribió.

Milgram murió en 1984 antes de finalizar sus investigaciones, y sus experimentos con cyranoides permanecieron en el olvido durante dos décadas antes de que Gillespie decidiera recuperar la idea.

Zombis vivientes

El argumento filosófico es que la gente es muy mala juzgando si alguien actúa por propia voluntad, o si es un "zombi" a las órdenes de otro.

Es fácil ser escéptico, pero yo también caí en la trampa cuando visité los laboratorios y Gillespie me presentó a Corti.

La mujer joven que estaba enfrente de mí no se parecía en nada a las fotos que había visto de Kevin, pensé.

Me dije que quizás Kevin era transgénero. De hecho, Kevin estaba en otra habitación y yo estaba hablando con Sofía (que, en la vida real, es una estudiante de LSE que ha realizado sus propios experimentos con la misma instalación).

Para mí, esto es una muestra de lo fácil que es caer en la trampa incluso cuando te la puedes esperar.

Claramente, conocer la ilusión cyranoide no es suficiente para romper su magia.

Ecoborgs

Con estos éxitos, Corti y Gillespie empezaron a pensar en otros extremos para el experimento, y entonces llegó el momento en que tuvieron la idea.

"Pensamos que podíamos llevarlo más allá de forma que ya no necesitásemos a una persona para generar las palabras".

El resultado fue un "ecoborg", una nueva cría de cyranoide en la que una persona transmite las palabras originadas por un programa, en lugar de una persona real.

En uno de los experimentos, los participantes no sabían que estaban hablando con un robot. Como hubiera predicho Milgram, tampoco se dieron cuenta incluso tras largas conversaciones.

Es raro pensar que nuestra primera emoción al enfrentarnos a robots futuros no será el terror que predice la ciencia ficción, sino la vergüenza"

Hay una trampa, sin embargo. El equipo intentó luego replicar el clásico "Test de Turing" de inteligencia artificial. Así que en otro intento, se les dijo a los participantes que podrían o no estar hablando con un robot, y tenían que averiguar cuál de ellos era.

Sorprendentemente, en esta situación el robot hablante no tenía más posibilidades de pasar el Test de Turing que si hubiesen estado hablando con una pantalla.

Es una especie de paradoja: sin saber que podríamos estar hablando con un robot, simplemente asumimos que nuestro interlocutor simplemente forma parte de una extraña parte del espectro de comportamiento humano.

Pero en cuanto sabemos que puede no ser humano, nos volvemos extra críticos con sus fallos.

¿Inquietante o embarazoso?

Gillespie está interesado en los dilemas que comporta este tipo de encuentro cara a cara.

"No puedes simplemente marcharte si los ojos te están mirando", dice Gillespie.

"Hay una obligación, y eso es lo que hace que la gente se vuelva rara, mientras que nunca te sentirías raro hablándole a una pantalla", dice Gillespie.

Lo entiendo. Cuando visité los laboratorios y hablé con Sophia, se le dio muy bien hablar de forma natural.

De hecho, si hubiésemos estado hablando en internet, me hubiera engañado(aunque puede ser que yo hubiera asumido que se trataba de una confabuladora)".

Pero cara a cara con sus respuestas extrañas, cualquier pausa o hipo se volvía insoportable, de una forma que no hubiera experimentado si hubiésemos estado chateando por Messenger.

Por eso, Gillespie cree que los robots hablantes pueden tener el problema del efecto del "valle inquietante".

Cuanto más realistas son las réplicas computerizadas de humanos, más extrañas parecen, un fenómeno que se ve en algunas películas de animación.

Si añades capacidad de conversación, se vuelve aún más raro. "A medida que la inteligencia artificial se acerca más a lo humano, no es solo inquietante, es también incómodo", dice.

Es raro pensar que nuestra primera emoción al enfrentarnos a robots futuros no será el terror que predice la ciencia ficción, sino la vergüenza.

Superar este problema será crucial si la Inteligencia Artificial pasa a ser parte de nuestras vidas, por eso Corti y Gillespie quieren continuar con sus experimentos con los ecoborg.

En su esencia, estos experimentos pueden incluso cuestionar qué significa estar vivo. Consideremos que haya un robot que se parezca a Sophia el ecoborg, pero sin esa conversación poco natural.

"¿Hay algo más en las personas que su comportamiento?", se pregunta Corti,

Porque si una máquina puede copiar nuestras dimensiones físicas y nuestro comportamiento, ¿por qué no llamaríamos a eso humano?

No hay comentarios:

Publicar un comentario